#两位科学家因在机器学习领域所做出的发现获得诺贝尔物理学奖#人工智能的两位先驱约翰·霍普菲尔德 (John Hopfield) 和杰弗里·辛顿 (Geoffrey Hinton) 周二荣获诺贝尔物理学奖,因为他们帮助创建了机器学习的基石,机器学习正在彻底改变我们的工作和生活方式,但也给人类带来了新的威胁。

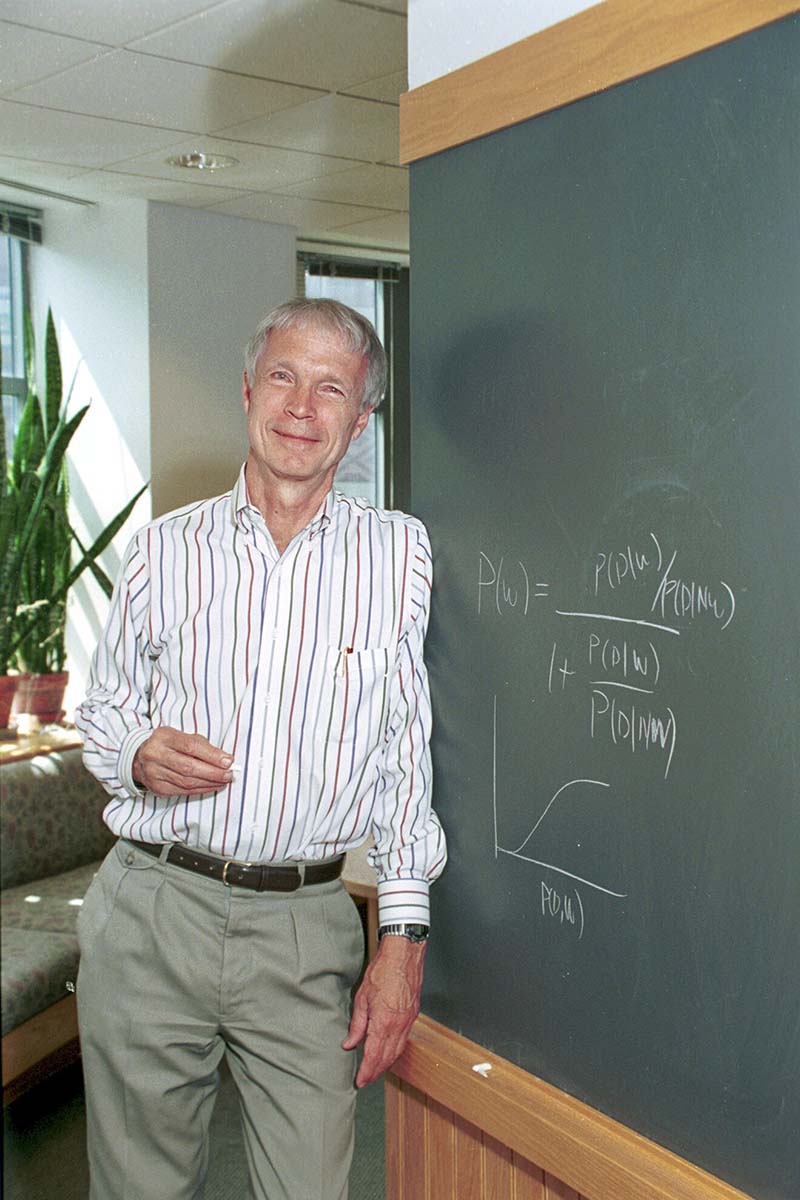

约翰·霍普菲尔德 (John Hopfield) 和杰弗里·辛顿 (Geoffrey Hinton)(如图所示)荣获今年的诺贝尔物理学奖,该奖项由瑞典科学院常务秘书长汉斯·埃勒格伦 (Hans Ellergren)(中)于 2024 年 10 月 8 日星期二在瑞典斯德哥尔摩举行的新闻发布会上宣布图片来源:Christine Olsson/TT 通讯社,来自美联社

被誉为人工智能教父的辛顿是加拿大和英国公民,在多伦多大学工作,霍普菲尔德是美国人,在普林斯顿大学工作。

“这两位先生确实是先驱,”诺贝尔物理学委员会成员马克·皮尔斯说。

瑞典皇家科学院诺贝尔委员会的埃伦·穆斯(Ellen Moons)表示,研究人员开创的人工神经网络(受人脑神经元启发的互连计算机节点)被广泛应用于科学和医学领域,“也已成为我们日常生活的一部分”。科学。

霍普菲尔德 1982 年的工作为辛顿的工作奠定了基础,他告诉美联社,“我仍然对它所产生的影响感到惊讶。”

辛顿预测,人工智能最终将对文明产生“巨大影响”,带来生产力和医疗保健的改善。

“这将与工业革命相媲美,”他在与记者和瑞典皇家科学院官员的公开电话会议上说。

“我们没有经历过拥有比我们更聪明的东西是什么感觉。这在很多方面都会很棒,”辛顿说。

“但我们也必须担心一些可能的不良后果,特别是这些事情失控的威胁。”

人工智能先驱 Geoffrey Hinton 在 2024 年 6 月 19 日星期三于多伦多举行的碰撞会议上发表讲话。图片来源:Chris Young/加拿大媒体,美联社、File

人工智能风险警告

诺贝尔委员会还提到了对可能出现的相反情况的担忧。

穆恩斯表示,虽然它有“巨大的好处,但它的快速发展也引发了对我们未来的担忧。总的来说,人类有责任以安全和合乎道德的方式使用这项新技术,以实现人类的最大利益。”

辛顿辞去了谷歌的职务,以便能够更自由地谈论他帮助创造的技术的危险,他也有同样的担忧。

辛顿说:“我担心这样做的总体后果可能是比我们更智能的系统最终会取得控制权。”

就霍普菲尔德而言,他签署了研究人员的早期请愿书,呼吁对这项技术进行强有力的控制,他比较了病毒和核能研究的风险和收益,这些研究能够帮助和伤害社会。在普林斯顿大学的新闻发布会上,他提到了这些担忧,提到了乔治·奥威尔的《1984》中想象的反乌托邦,或者库尔特·冯内古特的《猫的摇篮》中一位诺贝尔奖获得者物理学家无意中创造的虚构的世界末日。

两位获奖者当时都不在家接到电话

计算机科学家 Geoffrey Hinton 于 2015 年 3 月 25 日星期三在 Google 加利福尼亚州山景城总部摆出姿势拍照。图片来源:美联社照片/Noah Berger,文件

霍普菲尔德和妻子住在英国汉普郡的一间小屋里,他说,喝完咖啡并注射流感疫苗后,他打开电脑进行了一系列活动。

“我一生中从未见过这么多电子邮件,”他说。他补充说,一瓶香槟和一碗汤正在等待,但他怀疑镇上是否有其他物理学家参加庆祝活动。

辛顿表示,他对这一荣誉感到震惊。

“我惊呆了。我不知道会发生这种事,”当诺贝尔委员会通过电话联系到他时,他说道。他说他住在一家没有互联网的廉价旅馆。

Hinton 的工作被认为是人工智能的“诞生”

76 岁的 Hinton 在 20 世纪 80 年代帮助开发了一种称为反向传播的技术,用于训练机器如何通过微调错误直到错误消失来“学习”。这类似于学生的学习方式,对初始解决方案进行评分,发现缺陷并返回以进行修复和修复。这个过程一直持续到答案与网络的现实版本相匹配为止。

辛顿在多伦多谷歌人工智能部门的第一个雇员尼克·弗罗斯特(Nick Frosst)表示,辛顿拥有非传统的心理学家背景,他还涉足木工活,并且对大脑如何运作感到真正好奇。

安德斯·伊尔巴克 (Anders Irbäck) 教授于 2024 年 10 月 8 日星期二在瑞典斯德哥尔摩瑞典皇家科学院举行的新闻发布会上解释了约翰·霍普菲尔德 (John Hopfield) 和杰弗里·辛顿 (Geoffrey Hinton) 获得 2024 年诺贝尔物理学奖后的工作。图片来源:Christine Olsson/TT News通过美联社代理

弗罗斯特说,“我认为,他的幽默感和对回答基本问题的真正兴趣是他作为一名科学家取得成功的关键。”

他也没有停止 20 世纪 80 年代的开创性工作。

弗罗斯特说:“他一直在尝试一些疯狂的事情,其中一些效果很好,而另一些则不然。” “但他们都为该领域的成功做出了贡献,并激励其他研究人员尝试新事物。”

多伦多大学的 Hinton 团队在 2012 年使用神经网络赢得了著名的 ImageNet 计算机视觉竞赛,令同行惊叹不已。这引发了一系列模仿者,“事后看来,在人工智能历史进程中,这是一个非常非常重要的时刻,斯坦福大学计算机科学家兼 ImageNet 创始人李飞飞说道。

“许多人认为现代人工智能的诞生,”她说。

Hinton 和其他人工智能科学家 Yoshua Bengio 和 Yann LeCun 于 2019 年获得了计算机科学最高奖——图灵奖。

辛顿在 2019 年告诉美联社:“很长一段时间,人们认为我们三个人所做的事情是无稽之谈。”“我想向年轻研究人员传达的信息是,如果每个人都告诉你你所做的事情很愚蠢,请不要犹豫。” ”。

随着科技行业开始利用人工智能创新,Hinton 以前的许多学生和合作者都跟随他进入了科技行业,其中一些人创办了自己的人工智能公司,包括 Frosst 的 Cohere 和 ChatGPT 制造商 OpenAI。 Hinton 说他在日常生活中使用机器学习工具。

“每当我想知道任何事情的答案时,我都会去问 GPT-4,”Hinton 在诺贝尔奖颁奖典礼上说道。 “我并不完全相信它,因为它会产生幻觉,但在几乎所有事情上它都不是一个很好的专家。这非常有用。”

这张未注明日期的照片于 2024 年 10 月 8 日星期二提供,照片拍摄者为约翰·霍普菲尔德 (John Hopfield) 教授。图片来源:普林斯顿大学传播办公室;丹尼斯·阿普尔怀特(美联社)

人工智能先驱工作的物理学奖意义重大

诺贝尔委员会表示,91 岁的霍普菲尔德创造了一种联想存储器,可以存储和重建图像以及数据中其他类型的模式。

正如辛顿从心理学进入这个领域一样,霍普菲尔德强调尖端科学是如何跨越物理、生物学和化学等科学领域的边界而产生的,而不是让研究人员停留在自己的领域。他说,这就是为什么这个奖项是物理学奖,并指出他的神经网络借鉴了凝聚态物理学。

对于科学领域中的重大复杂问题,“如果你没有受到物理学的激励,你就无法解决这类问题,”霍普菲尔德说。

虽然计算机科学没有诺贝尔奖,但李说,向人工智能先驱者颁发传统科学奖意义重大,这表明学科之间的界限已经变得模糊。

关于人工智能风险的分歧

并非所有同行都同意诺贝尔奖获得者关于他们帮助创造的技术的风险的看法。

弗罗斯特与辛顿就人工智能的风险进行了多次“激烈的辩论”,他不同意辛顿的一些警告,但不同意他公开解决这些问题的意愿。

人工智能先驱杰弗里·辛顿 (Geoffrey Hinton) 于 2024 年 6 月 19 日星期三在多伦多碰撞会议后台摆出姿势拍照。图片来源:Chris Young/加拿大媒体,美联社、File

弗罗斯特说:“我们主要在时间尺度和他发出警报的特定技术上存在分歧。” “我不认为现有的神经网络和语言模型会带来生存风险。”

本吉奥长期以来一直对人工智能风险发出警报,他表示,真正让他和辛顿感到震惊的是“人类失去控制”,以及人工智能系统在比人类更聪明时是否会按照道德行事。

“我们不知道这些问题的答案,”他说。 “我们应该确保在建造这些机器之前我们做到了。”

当被问及诺贝尔委员会在决定奖项时是否考虑了辛顿的警告时,本吉奥对此予以否认,他说:“当我们认为一切都会很美好时,我们正在谈论非常早期的工作。”

为期六天的诺贝尔奖颁奖典礼周一拉开帷幕,美国人维克多·安布罗斯和加里·鲁夫昆荣获医学奖。他们周三继续颁发化学奖,周四继续颁发文学奖。诺贝尔和平奖将于周五公布,经济学奖将于 10 月 14 日公布。

该奖项包括 1100 万瑞典克朗(100 万美元)的现金奖励,该奖金来自该奖项的创始人、瑞典发明家阿尔弗雷德·诺贝尔留下的遗赠。获奖者将受邀在 12 月 10 日诺贝尔逝世周年纪念日的颁奖典礼上接受颁奖。

诺贝尔委员会公告:

瑞典皇家科学院决定将2024年诺贝尔物理学奖授予

约翰·J·霍普菲尔德,美国新泽西州普林斯顿大学

Geoffrey E. Hinton,加拿大多伦多大学

“通过人工神经网络实现机器学习的基础发现和发明”

他们利用物理学训练人工神经网络

今年的两位诺贝尔物理学奖获得者使用物理学工具开发了为当今强大的机器学习奠定基础的方法。约翰·霍普菲尔德(John Hopfield)创建了一种联想存储器,可以存储和重建图像以及数据中其他类型的模式。 Geoffrey Hinton 发明了一种方法,可以自动查找数据中的属性,从而执行识别图片中特定元素等任务。

当我们谈论人工智能时,我们通常指的是使用人工神经网络的机器学习。这项技术最初的灵感来自于大脑的结构。在人工神经网络中,大脑的神经元由具有不同值的节点表示。这些节点通过类似于突触的连接相互影响,并且可以变得更强或更弱。例如,通过在同时具有高值的节点之间建立更强的连接来训练网络。今年的获奖者从 20 世纪 80 年代起就在人工神经网络方面开展了重要工作。

约翰·霍普菲尔德发明了一种网络,该网络使用一种保存和重新创建模式的方法。我们可以将节点想象为像素。 Hopfield 网络利用物理学来描述材料由于原子自旋而产生的特性,这种特性使每个原子都成为微小的磁铁。整个网络以相当于物理学中自旋系统能量的方式进行描述,并通过查找节点之间的连接值进行训练,以便保存的图像具有低能量。当 Hopfield 网络输入扭曲或不完整的图像时,它会系统地通过节点工作并更新它们的值,从而使网络的能量下降。因此,网络逐步工作,找到最接近其输入的不完美图像的已保存图像。

Geoffrey Hinton 使用 Hopfield 网络作为使用不同方法的新网络的基础:玻尔兹曼机。这可以学习识别给定类型数据中的特征元素。 Hinton 使用了统计物理学中的工具,统计物理学是由许多相似组件构建的系统科学。通过向机器提供运行时很可能出现的示例来训练机器。玻尔兹曼机可用于对图像进行分类或创建其所训练的模式类型的新示例。 Hinton 在这项工作的基础上,帮助启动了当前机器学习的爆炸性发展。

“获奖者的工作已经带来了最大的好处。在物理学中,我们在广泛的领域中使用人工神经网络,例如开发具有特定性能的新材料,”诺贝尔物理学委员会主席埃伦·穆斯 (Ellen Moons) 说。

2024 年诺贝尔物理学奖

今年的获奖者使用物理学工具构建了为当今强大的机器学习奠定基础的方法。约翰·霍普菲尔德(John Hopfield)创建了一种可以存储和重建信息的结构。 Geoffrey Hinton 发明了一种可以独立发现数据属性的方法,这对于现在使用的大型人工神经网络来说已经变得很重要。

他们利用物理学来寻找信息模式

许多人都体验过计算机如何在语言之间进行翻译、解释图像甚至进行合理的对话。也许不太为人所知的是,这种技术长期以来对研究很重要,包括对大量数据的排序和分析。机器学习的发展在过去十五到二十年中呈爆炸式增长,并利用了一种称为人工神经网络的结构。如今,当我们谈论人工智能时,我们通常指的是这种技术。

尽管计算机无法思考,但机器现在可以模仿记忆和学习等功能。今年的物理学奖得主帮助实现了这一目标。他们利用物理学的基本概念和方法,开发了利用网络结构来处理信息的技术。

机器学习与传统软件不同,传统软件的工作原理就像一种菜谱。该软件接收数据,根据清晰的描述进行处理并产生结果,就像有人收集原料并按照食谱进行处理以生产蛋糕一样。相反,在机器学习中,计算机通过示例进行学习,使其能够解决过于模糊和复杂而无法通过逐步指令进行管理的问题。一个例子是解释一张图片以识别其中的对象。

模仿大脑

人工神经网络使用整个网络结构来处理信息。灵感最初来自于了解大脑如何运作的愿望。 20 世纪 40 年代,研究人员开始围绕大脑神经元和突触网络的数学原理进行推理。另一个难题来自心理学,这要归功于神经科学家唐纳德·赫布(Donald Hebb)的假设,即学习是如何发生的,因为当神经元一起工作时,它们之间的联系会得到加强。

后来,这些想法被尝试通过构建人工神经网络作为计算机模拟来重建大脑网络的功能。在这些模型中,大脑的神经元由被赋予不同值的节点来模拟,突触由节点之间的连接来表示,这些连接可以变得更强或更弱。唐纳德·赫布的假设仍然被用作通过训练过程更新人工网络的基本规则之一。

20 世纪 60 年代末,一些令人沮丧的理论结果导致许多研究人员怀疑这些神经网络永远不会有任何实际用途。然而,人们对人工神经网络的兴趣在 20 世纪 80 年代重新被唤醒,当时几个重要的想法产生了影响,其中包括今年获奖者的工作。

联想记忆

想象一下,您正在尝试记住一个您很少使用的相当不寻常的单词,例如用于电影院和演讲厅中常见的倾斜地板的单词。你搜索你的记忆。有点像斜坡……也许是径向……径向?不,不是那样。雷克,就是这样!

这种搜索相似单词以找到正确单词的过程让人想起物理学家约翰·霍普菲尔德 (John Hopfield) 在 1982 年发现的联想记忆。Hopfield 网络可以存储模式,并有一种重新创建它们的方法。当给网络一个不完整或轻微扭曲的模式时,该方法可以找到最相似的存储模式。

霍普菲尔德此前曾利用他的物理学背景来探索分子生物学的理论问题。当他受邀参加一个有关神经科学的会议时,他遇到了有关大脑结构的研究。他对所学到的东西很着迷,并开始思考简单神经网络的动力学。当神经元一起行动时,它们可以产生新的、强大的特征,而这些特征对于只关注网络独立组件的人来说是不明显的。

1980 年,霍普菲尔德离开了他在普林斯顿大学的职位,他的研究兴趣使他离开了物理学同事们工作的领域,并搬到了整个非洲大陆。他接受了南加州帕萨迪纳市加州理工学院化学和生物学教授职位的邀请。在那里,他可以使用计算机资源进行免费实验并发展他关于神经网络的想法。

然而,他并没有放弃自己的物理学基础,在那里他找到了灵感,理解了具有许多小组件协同工作的系统如何产生新的有趣的现象。他特别受益于了解磁性材料,这些材料由于原子自旋而具有特殊特性,这种特性使每个原子都成为微小的磁铁。相邻原子的自旋相互影响;这可以允许形成具有相同方向自旋的域。他能够利用物理学描述材料在自旋相互影响时如何发展,从而建立一个具有节点和连接的模型网络。

网络以风景形式保存图像

霍普菲尔德构建的网络具有通过不同强度的连接连接在一起的节点。每个节点都可以存储一个单独的值——在 Hopfield 的第一个作品中,这个值可以是 0 也可以是 1,就像黑白图片中的像素一样。

霍普菲尔德描述了网络的整体状态,其属性相当于物理学中自旋系统中的能量;能量是使用一个公式计算的,该公式使用节点的所有值以及它们之间的所有连接强度。 Hopfield 网络通过馈送到节点的图像进行编程,节点被赋予黑色 (0) 或白色 (1) 值。然后使用能量公式调整网络的连接,以便保存的图像获得低能量。当另一种模式被输入网络时,有一个规则会逐个遍历节点,并检查如果该节点的值发生变化,网络是否具有较低的能量。如果事实证明,如果黑色像素变成白色,能量就会减少,它就会改变颜色。这个过程一直持续到不可能找到任何进一步的改进为止。当达到这一点时,网络通常会再现其训练时所用的原始图像。

如果您只保存一种模式,这可能不会显得那么引人注目。也许您想知道为什么不直接保存图像本身并将其与正在测试的另一张图像进行比较,但 Hopfield 的方法很特殊,因为可以同时保存多张图片,并且网络通常可以区分它们。

霍普菲尔德将在网络中搜索已保存的状态比作在山峰和山谷中滚动一个球,摩擦力会减慢其运动速度。如果球掉落在特定位置,它会滚入最近的山谷并停在那里。如果给网络一个接近已保存模式之一的模式,它将以同样的方式继续前进,直到到达能量景观中的山谷底部,从而找到其记忆中最接近的模式。

Hopfield 网络可用于重新创建包含噪声或已部分擦除的数据。

Hopfield 和其他人继续开发 Hopfield 网络功能的细节,包括可以存储任何值的节点,而不仅仅是零或一。如果您将节点视为图片中的像素,那么它们可以具有不同的颜色,而不仅仅是黑色或白色。改进的方法使得保存更多图片成为可能,并且即使它们非常相似也能够区分它们。识别或重建任何信息都是可能的,只要它是由许多数据点构建的。

使用十九世纪物理学进行分类

记住图像是一回事,但解释它所描绘的内容则需要更多。

即使很小的孩子也可以指着不同的动物并自信地说出它是狗、猫还是松鼠。他们偶尔可能会出错,但很快他们几乎总是正确的。即使没有看到任何图表或物种或哺乳动物等概念的解释,孩子也可以学到这一点。在遇到每种动物的一些例子后,不同的类别就会在孩子的头脑中就位。人们通过体验周围的环境来学习识别一只猫,或者理解一个单词,或者进入一个房间并注意到某些东西发生了变化。

当霍普菲尔德发表有关联想记忆的文章时,杰弗里·辛顿正在美国匹兹堡的卡内基梅隆大学工作。他之前曾在英格兰和苏格兰研究过实验心理学和人工智能,并且想知道机器是否可以学习以与人类类似的方式处理模式,找到自己的类别来排序和解释信息。 Hinton 与他的同事 Terrence Sejnowski 一起从 Hopfield 网络开始,并利用统计物理学的思想将其扩展以构建新的东西。

统计物理学描述由许多相似元素组成的系统,例如气体中的分子。追踪气体中的所有单独分子是困难或不可能的,但可以将它们集中考虑以确定气体的总体特性,例如压力或温度。气体分子有许多潜在的方式以各自的速度在其体积中扩散,但仍然产生相同的集体特性。

可以使用统计物理学来分析各个组件可以共同存在的状态,并计算它们发生的概率。有些状态比其他状态更有可能发生;这取决于可用能量的大小,十九世纪物理学家路德维希·玻尔兹曼用方程描述了这一点。 Hinton 的网络利用了该方程,该方法于 1985 年以玻尔兹曼机的醒目名称发布。

识别相同类型的新例子

玻尔兹曼机通常与两种不同类型的节点一起使用。信息被馈送到一组,称为可见节点。其他节点形成隐藏层。隐藏节点的值和连接也为整个网络的能量做出了贡献。

该机器通过应用一种规则来运行,一次更新一个节点的值。最终,机器将进入一种状态,其中节点的模式可以改变,但整个网络的属性保持不变。然后,每种可能的模式都将具有特定的概率,该概率由网络能量根据玻尔兹曼方程确定。当机器停止时,它会创建一个新的模式,这使得玻尔兹曼机成为生成模型的早期例子。

玻尔兹曼机可以学习——不是从指令中学习,而是从给出的例子中学习。它通过更新网络连接中的值来进行训练,以便在训练时馈送到可见节点的示例模式在机器运行时具有最高的可能出现概率。如果在训练过程中多次重复相同的模式,则出现该模式的概率会更高。训练还会影响输出与机器训练示例类似的新模式的概率。

经过训练的玻尔兹曼机可以识别以前未见过的信息中的熟悉特征。想象一下,见到一个朋友的兄弟姐妹,你立刻就能看出他们一定有亲戚关系。以类似的方式,玻尔兹曼机可以识别一个全新的例子,如果它属于训练材料中找到的类别,并将其与不相似的材料区分开来。

在其原始形式中,玻尔兹曼机效率相当低,并且需要很长时间才能找到解决方案。当事物以多种方式发展时,它会变得更加有趣,这是 Hinton 不断探索的。后来的版本已被精简,因为某些单元之间的连接已被删除。事实证明,这可能会使机器更加高效。

20 世纪 90 年代,许多研究人员对人工神经网络失去了兴趣,但 Hinton 是继续在该领域工作的人之一。他还帮助开启了新一轮令人兴奋的成果; 2006 年,他和同事 Simon Osindero、Yee Whye Teh 和 Ruslan Salakhutdinov 开发了一种预训练网络的方法,该方法使用一系列分层的玻尔兹曼机,一个在另一个之上。这种预训练为网络中的连接提供了一个更好的起点,从而优化了其识别图片中元素的训练。

玻尔兹曼机通常用作较大网络的一部分。例如,它可以用于根据观众的喜好推荐电影或电视剧。

机器学习——今天和明天

凭借 20 世纪 80 年代及以后的工作,John Hopfield 和 Geoffrey Hinton 为 2010 年左右开始的机器学习革命奠定了基础。

我们现在所见证的发展是通过访问可用于训练网络的大量数据以及通过计算能力的巨大提高而实现的。当今的人工神经网络通常非常庞大并且由许多层构成。这些被称为深度神经网络,它们的训练方式被称为深度学习。

快速浏览一下 Hopfield 1982 年发表的关于联想记忆的文章,可以对这一发展提供一些观点。在其中,他使用了一个有 30 个节点的网络。如果所有节点都相互连接,则有 435 个连接。节点有其值,连接有不同的强度,总共需要跟踪的参数不到 500 个。他还尝试了一个有 100 个节点的网络,但考虑到他当时使用的计算机,这太复杂了。我们可以将其与当今的大型语言模型进行比较,这些模型被构建为可以包含超过一万亿个参数(一百万个)的网络。

许多研究人员现在正在开发机器学习的应用领域。哪一个最可行还有待观察,同时围绕这项技术的开发和使用的道德问题也存在广泛的讨论。

由于物理学为机器学习的发展提供了工具,因此观察物理学作为一个研究领域如何从人工神经网络中受益是很有趣的。机器学习早已应用于我们之前诺贝尔物理学奖所熟悉的领域。其中包括使用机器学习来筛选和处理发现希格斯粒子所需的大量数据。其他应用包括减少黑洞碰撞引力波测量中的噪音,或寻找系外行星。

近年来,这项技术也开始用于计算和预测分子和材料的特性,例如计算蛋白质分子的结构,这决定了它们的功能,或者计算出材料的哪些新版本可能具有最佳特性用于更高效的太阳能电池。